O uso da Inteligência Artificial (IA) tornou-se notavelmente acessível, transformando-se em uma prática cotidiana para muitos. A simples ação de abrir um aplicativo, digitar um comando e aguardar alguns segundos pode parecer trivial. No entanto, essa aparente facilidade esconde um complexo e dispendioso mundo industrial. Por trás de cada consulta, existem data centers, redes, eletricidade, resfriamento, chips especializados e investimentos que somam bilhões de dólares, todos necessários para sustentar essa tecnologia que vai muito além do romantismo tecnológico.

A popularização da IA generativa induziu a uma perigosa ilusão: que o acesso é barato, uma vez que a interação do usuário é simples. Contudo, o conforto de um comando não reflete os custos estruturais que estão em jogo. Segundo a Agência Internacional de Energia (AIE), a demanda elétrica dos data centers saltou de cerca de 485 TWh em 2025 para uma previsão de 950 TWh em 2030, com os data centers focados em IA apresentando um crescimento dentro de 50% somente em 2025. Essa não é apenas uma curiosidade tecnológica, mas sim uma nova camada industrial com impactos diretos nas redes elétricas, investimentos e margens de lucro.

O problema vai além das interações individuais, destacando-se na escala de uso. Estudos, como o da Epoch AI, estimam que uma consulta típica ao ChatGPT utilizando o modelo GPT-4o consome aproximadamente 0,3 Wh de energia, bem abaixo de estimativas anteriores. No entanto, a verdadeira preocupação surge quando se considera a quantidade massiva de interações. Ao passo que uma ferramenta pode lidar com milhares de consultas, a transição para bilhões eleva significativamente o custo por solicitação, tornando-se uma variável crucial para os negócios.

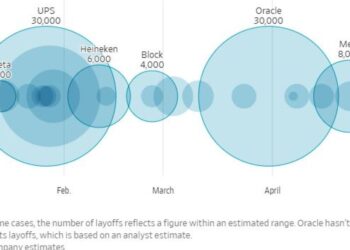

Grandes empresas de tecnologia estão se empenhando em grandes investimentos para a manutenção dessa demanda crescente. A Amazon, por exemplo, planeja um investimento em capital de cerca de 200 bilhões de dólares para 2026, muito do qual estará vinculado ao AWS e à demanda por IA. A Microsoft anunciou um gasto trimestral de capital de 37,5 bilhões de dólares, com uma significativa parte voltada para ativos de curto prazo como GPUs e CPUs. Por sua vez, o Alphabet projeta um capex entre 175 e 185 bilhões de dólares, focando em infraestrutura técnica para IA.

A IA não é simples, pois oculta uma indústria colossal. Enquanto para o usuário a interface se apresenta de maneira amigável, para os operadores é um cenário de planejamento de capacidade, disponibilidade de energia e complexidade logística. Essa diferença de opiniões esclarece porque o mercado está se ajustando, visto que nenhuma empresa faria investimentos tão altos se não esperasse um retorno.

Outro desafio é físico. A densidade dos racks de IA já chega a níveis como 70-80 kW, exigindo uma reconsideração na distribuição elétrica e no resfriamento. A AIE destaca que a eletricidade necessária para os data centers deve passar de 460 TWh em 2024 para mais de 1.000 TWh em 2030, com a energia renovável cobrindo a metade da demanda adicional. A IA está, portanto, impulsionando uma expansão industrial que se entrelaça com o debate energético global.

As futuras composições do mercado se basearão em um ciclo de monetização, onde a fase de expansão dará lugar à necessidade de demonstrar retorno sobre o investimento. À medida que as empresas buscam diferenciar entre usos de alto valor e aplicações triviais, a IA pode deixar de parecer acessível e se transformar em uma utilidade digital custosa, governada por custos energéticos e exigências de capacidade.

Em resumo, a ascensão da IA não deve ser vista como um fenômeno efêmero, mas como parte de uma revolução industrial em curso, marcando uma nova era na interação tecnologia e infraestrutura.