Amazon Web Services (AWS) e Cerebras estabelecem parceria para acelerar a inferência em Inteligência Artificial

A Amazon Web Services (AWS) anunciou uma nova colaboração com a Cerebras, visando reforçar a velocidade de inferência em sua plataforma de inteligência artificial. A parceria permitirá que a nuvem da Amazon implemente sistemas Cerebras CS-3 em seus centros de dados, tornando-os disponíveis para os clientes por meio do Amazon Bedrock. As empresas afirmam que o novo serviço estará disponível nos próximos meses, e que em 2026 será possível executar modelos abertos e o Amazon Nova no hardware da Cerebras.

Essa aliança não se resume apenas à inclusão de mais uma opção de hardware no portfolio da AWS. A proposta envolve a divisão das fases do processo de inferência, separando o “prefill”, responsável pelo processamento do prompt inicial, e o “decode”, que gera os tokens de saída. De acordo com a Amazon, essa abordagem permitirá que cada chip desempenhe as funções para as quais é mais adequado.

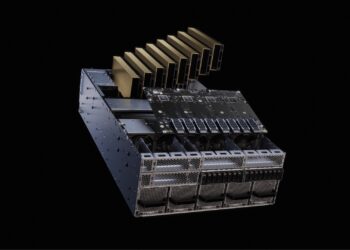

O design técnico da nova solução, que faz uso do chip Trainium da AWS para a fase de prefill, enquanto o Cerebras CS-3 cuidará do decode, destaca uma ideia clara, mas desafiadora em sua execução. A interconexão entre os dois sistemas será realizada através do Elastic Fabric Adapter, a conexão de alto desempenho da Amazon. A estimativa é que essa configuração possa oferecer até cinco vezes mais capacidade de geração de tokens rapidamente dentro do mesmo espaço físico.

O prefill, por ser uma tarefa intensiva em computação paralela, e o decode, que demanda acesso contínuo à memória, representam um gargalo crescente na atual corrida por soluções em IA. A Cerebras afirma que seu sistema CS-3 possui uma arquitetura capaz de oferecer até 15 vezes mais rapidez em cenários específicos de inferência em comparação com alternativas baseadas em GPU.

Com este movimento, a AWS busca não apenas resolver os gargalos de computação, mas também estabelecer o Amazon Bedrock como uma plataforma mais robusta para acesso a modelos e serviços de IA. Além disso, a Amazon enfatizou que a nova infraestrutura será executada de maneira integrada dentro de sua nuvem, preservando os padrões de segurança e isolamento que seus clientes valorizam.

Embora a parceria prometa facilitar a inferência em tempo real, as empresas também alertaram que as configurações entre prefill e decode poderão variar de acordo com as necessidades dos clientes, reconhecendo que muitas aplicações ainda podem requerer uma arquitetura mais tradicional.

Em um momento em que a velocidade de resposta se torna crucial, especialmente para ferramentas de assistentes e programação, este anúncio destaca a intenção da AWS de não somente expandir seu leque de ofertas, mas de também se distanciar da simples corrida por GPU, construindo um ecossistema integrado que possa atender à demanda crescente por inferência ágil em inteligência artificial.