Nos últimos dias, um debate tem circulado nas redes sociais, afirmando que a NVIDIA “admitiu” que sua arquitetura de chip para Inteligência Artificial está “quebrada”, uma vez que lançou um novo modelo que utiliza memória GDDR em vez de HBM. Embora a frase possa soar como um título perfeito para atrair cliques, a realidade é muito mais complexa e interessante. A NVIDIA está, na verdade, respondendo a uma mudança significativa na forma como a Inteligência Artificial é consumida na produção, onde a enfase não está mais apenas no treinamento de modelos, mas também em servi-los de maneira eficiente, especialmente quando lidamos com grandes volumes de dados.

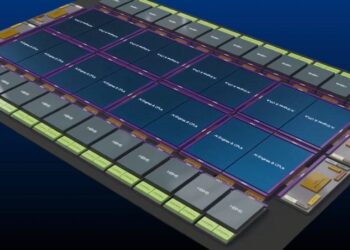

Nesse contexto surge o Rubin CPX, um acelerador projetado especificamente para intensificar o processamento do contexto na inferência de IA. Em vez de tentar ser um “chip para tudo”, a proposta da NVIDIA é separar as fases do processo e, consequentemente, os custos relacionados. O Rubin CPX é direcionado a cenários de inferência que requerem a leitura de grandes quantidades de informações antes de gerar respostas, como documentos longos, históricos de dados ou códigos complexos.

Esse novo chip se integra à plataforma Vera Rubin NVL144 da NVIDIA, que contém aceleradores projetados para diferentes necessidades de inferência, com um foco constante em eficiência. A abordagem “separar fases” é uma resposta à constatação de que os fluxos de trabalho que envolvem a IA estão se tornando mais distintos e que a separação das fases de pré-processamento e geração pode oferecer vantagens de custo significativas.

O motor por trás dessa mudança é o crescimento da Inteligência Artificial em produção, que frequentemente opera com contextos mais longos. Com isso, as duas etapas envolvidas, o prefill (processamento do contexto) e o decode (geração de resposta), não podem mais ser tratadas da mesma forma. A NVIDIA reconhece que certas operações se beneficiam de uma abordagem distinta, refletindo uma adaptação do hardware às novas demandas do mercado.

É importante destacar que a separação de fases traz consigo grandes desafios técnicos, como a necessidade de mover e coordenar o estado entre diferentes nodos do sistema, o que pode gerar latências se não for bem executado. A NVIDIA já começou a trabalhar em soluções com o Dynamo, uma camada de orquestração para escalar a inferência e otimizar a transferência de dados entre diferentes etapas.

Além disso, a pressão concorrencial no setor também é crescente, com grandes provedores de nuvem como Google e AWS desenvolvendo seus próprios chips, como TPUs e Trainium, para reduzir a dependência de terceiros e atender melhor às suas necessidades específicas na área de IA. O mercado está claramente se movendo em direção a um modelo em que as empresas exigem eficiência e opções personalizadas.

Em resumo, a NVIDIA não está “admitindo” uma falha em sua abordagem anterior; em vez disso, está reconhecendo a evolução das necessidades do mercado e adaptando suas soluções. Com o Rubin CPX, a NVIDIA pretende atender a uma nova realidade em que o processamento de contexto e a geração de resposta exigem recursos separados e otimizados, refletindo uma mudança significativa no paradigma de inferência de IA.